Retrieval-Augmented Generation: Was du über RAG wissen musst.

Retrieval-Augmented Generation (RAG) ist eine Technologie, die generative Sprachmodelle durch das Abrufen relevanter Informationen aus externen und internen Datenquellen verbessert, um präzisere und kontextuell relevante Antworten zu liefern. Wir stellen dir das Konzept von RAG vor und erklären, wie du es in deinem Unternehmen richtig einsetzen kannst.

Was ist Retrieval-Augmented Generation?

Retrieval-Augmented Generation (RAG) ist eine Technologie zur Optimierung der Ergebnisse eines Large Language Models (LLM). Einfach erklärt arbeitet RAG so: Erhält das System eine Anfrage, durchsucht es zuerst riesige Mengen an externen Daten nach passenden Informationen. Das können interne Datenbanken, das Web oder andere Quellen sein. Sobald die richtigen Daten gefunden sind, nutzt das System smarte Algorithmen, um daraus eine klare und exakte Antwort zu erstellen.

Große Sprachmodelle (LLMs) sind die Basis für künstliche Intelligenzen (KI), besonders für schlaue Chatbots, die auf Natural Language Processing setzen. Das Ziel dabei: Bots zu entwickeln, die User-Fragen in jedem Kontext präzise beantworten, indem sie auf verlässliche Wissensquellen zugreifen.

Trotz ihrer Power haben LLMs Grenzen. Manchmal liefern sie falsche Antworten, wenn ihnen Infos fehlen. Da sie mit Web-Texten trainiert wurden, übernehmen sie oft dort verbreitete Vorurteile. Zudem ist ihr Wissen auf den Zeitpunkt des Trainings begrenzt. Das führt dazu, dass Nutzer:innen oft veraltete Informationen erhalten.

Kombiniert man RAG mit LLMs, lösen sich diese Probleme. Retrieval-Augmented Generation erweitert die Fähigkeiten von LLMs, indem es aktuelle Fakten findet und verarbeitet. Das Ergebnis sind exaktere und vertrauenswürdige Antworten.

Wie funktioniert RAG?

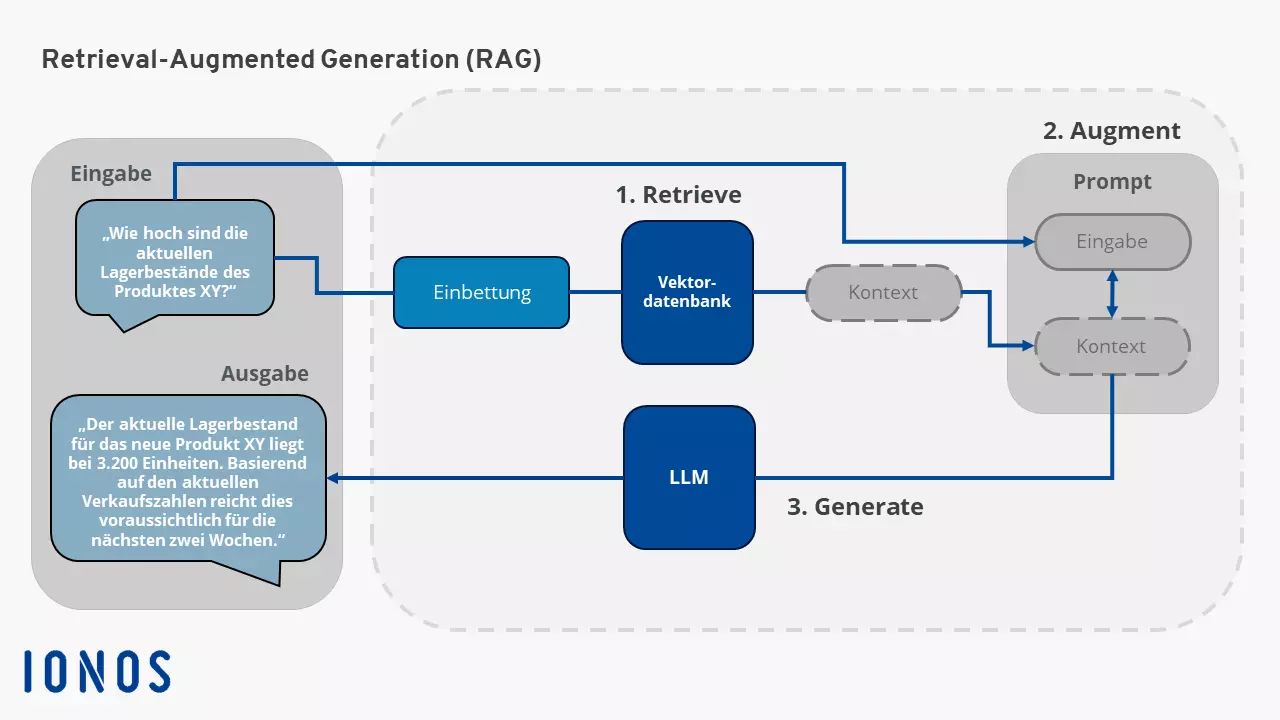

Die Retrieval-Augmented Generation geht in mehreren Schritten vor, um nützliche Antworten zu liefern. Hier ist der Ablauf im Detail:

Vorbereitung der Wissensbasis

Zuerst braucht es eine breite Sammlung an Texten, Daten oder Dokumenten. Diese dient neben dem Trainingsset des LLM als zusätzliche Wissensquelle, auf die das RAG-Modell zugreift. Die Daten können aus Datenbanken oder Cloud-Speichern kommen.

Ein RAG-System ist nur so gut wie seine Datenbasis. Lückenhafte oder falsche Quellen verschlechtern das Ergebnis unmittelbar.

Einbettung in Vektordatenbanken

Ein Kernpunkt von RAG sind Embeddings. Das sind numerische Profile von Informationen, mit denen Sprachmodelle Ähnlichkeiten erkennen. So findet ein Modell Dokumente basierend auf ihrer Bedeutung. Diese Daten liegen in Vektordatenbanken, die eine KI blitzschnell durchsuchen kann. Damit alles aktuell bleibt, müssen Dokumente und Vektoren regelmäßig synchronisiert werden.

Abfrage relevanter Informationen (Retrieve)

Stellt jemand eine Frage, wird diese in einen Vektor umgewandelt und mit der Vektordatenbank abgeglichen. Das System sucht genau die Datensätze heraus, die der Anfrage am nächsten kommen.

Erweiterung der Eingabeaufforderung (Augment)

Die gefundenen Infos werden via Prompt-Engineering in die ursprüngliche Anfrage eingebaut. Der neue Prompt enthält also die Frage plus die Fakten. So kann das LLM eine viel fundiertere Antwort geben.

Prompt-Engineering umfasst Methoden, um Eingabeaufforderungen (Prompts) für LLMs so zu gestalten, dass sie exakt die gewünschten Reaktionen und Ergebnisse liefern.

Antwortgenerierung (Generate)

Zuletzt erstellt das RAG-Modell die finale Antwort. Es nutzt die recherchierten Fakten und formuliert eine Antwort in natürlicher Sprache. Dabei kommen Technologien wie GPT-3 zum Einsatz, um die Daten für uns verständlich aufzubereiten.

GPTs (Generative Pre-trained Transformers) verstehen und erzeugen menschliche Sprache. Sie werden erst allgemein trainiert (Pre-training) und dann für Aufgaben spezialisiert (Fine-tuning).

Was sind die Vorteile von RAG?

Der Einsatz von Retrieval-Augmented Generation bringt deinem Business viele Pluspunkte:

Höhere Effizienz

Zeitersparnis ist Gold wert. RAG arbeitet effizienter als reine Riesen-Modelle, da es vorab nur die relevantesten Daten filtert. So muss in der finalen Phase deutlich weniger Material verarbeitet werden.

Kosten sparen

Durch RAG lassen sich Ausgaben senken. Routine-Recherchen werden automatisiert, was Personal entlastet und die Qualität sichert. Die Einführung von RAG ist zudem meist günstiger als ein ständiges Neu-Training ganzer LLMs.

Immer am neuesten Stand

RAG liefert topaktuelle News, indem es das LLM mit Live-Daten aus Social Media oder Nachrichtenportalen verknüpft. So bleibst du und deine Kundschaft immer am Puls der Zeit.

Schnell auf Trends reagieren

Wer fix auf Marktänderungen antwortet, gewinnt. Durch den sofortigen Zugriff auf Daten und einen proaktiven Support hebst du dich klar vom Wettbewerb ab.

Flexibles Testen & Steuern

Du behältst die volle Kontrolle über die Quellen. So lässt sich der Zugriff auf interne Daten präzise regeln. Falls das LLM einmal danebenliegt, kannst du via RAG gezielt korrigieren, indem du die Informationsbasis anpasst.

Wo wird Retrieval-Augmented Generation eingesetzt?

RAG optimiert Prozesse in vielen Unternehmensbereichen:

- Besserer Kundenservice: Schnelle Antworten sind Pflicht. RAG zieht Infos aus deiner Wissensdatenbank und ermöglicht präzise Live-Chats ohne Wartezeit. Das entlastet dein Team und sorgt für glückliche Kund:innen.

- Wissensmanagement: Mitarbeitende finden Infos sofort, statt stundenlang Ordner zu durchforsten.

- Onboarding: Neue Teammitglieder arbeiten sich schneller ein, da sie direkten Zugriff auf Handbücher, Guidelines und Schulungen haben.

- Content-Erstellung: RAG hilft beim Schreiben von Blogs, Produkttexten oder Artikeln, indem es Textgenese mit echtem Fakten-Check aus internen Quellen vereint.

- Marktforschung: Markttrends und Daten lassen sich viel schneller analysieren, was Entscheidungen beschleunigt.

- Produktion: Hier hilft RAG bei Prognosen zum Verbrauch oder bei der Einsatzplanung basierend auf historischen Werten für mehr Effizienz.

- Vertrieb: Sales-Teams haben Produktdetails sofort parat und können Kund:innen gezielte Empfehlungen geben, was den Umsatz steigert.

Tipps zur Einführung von RAG

Du kennst nun die Benefits – aber wie startest du? Analysiere zuerst deinen Bedarf. Wo bringt RAG den größten Hebel? Vielleicht im Support oder im Marketing? Setze dir klare Ziele, wie etwa die Verkürzung von Antwortzeiten.

Es gibt viele Anbieter für RAG-Lösungen. Vergleiche genau: Wie einfach ist die Bedienung? Passt das Tool zu deinen Systemen? Ist es skalierbar und was kostet es am Ende?

Nach der Wahl folgt die Integration in deine Workflows und Datenbanken (z. B. CRM). Eine glatte Einbindung ist die Basis für den Erfolg. Begleite dein Team mit Schulungen, damit alle die Technik souverän nutzen können.

Bleib nach dem Start dran und überprüfe die Performance regelmäßig. Optimiere dort, wo es hakt. Achte zudem penibel darauf, dass alle Daten DSGVO-konform und sicher verarbeitet werden. Das schützt dein Business und sorgt für Sorgenfreiheit bei deiner Kundschaft.