KI-Server: Definition, Hardware-Anforderungen und Vorteile

KI-Server sind spezialisierte Kraftpakete, die exakt auf das Training künstlicher Intelligenz zugeschnitten sind. Durch besonders leistungsfähige Hardware und spezifische Software heben sich AI-Server deutlich von klassischen Servermodellen ab.

Was zeichnet einen KI-Server aus?

Ein KI-Server (oder AI-Server) ist eine dedizierte Serverlösung, die für Anwendungen rund um künstliche Intelligenz und Maschinelles Lernen (ML) optimiert wurde. Um die enormen Rechenlasten moderner KI-Modelle zu stemmen, verfügen diese Systeme über modernste Komponenten. Während Standard-Server meist Webseiten hosten oder Datenbanken verwalten, sind KI-Server darauf spezialisiert, gewaltige Datenberge zu analysieren und komplexe Algorithmen in Rekordzeit zu berechnen.

Die Hardware-Power eines KI-Servers

Bei KI-Anwendungen zählt jedes Quäntchen Leistung. Da diese Prozesse extrem ressourcenhungrig sind, ist die Wahl der Hardware entscheidend. Das sind die Kernkomponenten:

- Grafikprozessoren (GPUs): Sie sind das Herzstück für parallele Datenverarbeitung, was vor allem beim Training von Deep-Learning-Modellen unverzichtbar ist.

- Zentralprozessoren (CPUs): Starke CPUs übernehmen die allgemeine Steuerung und sorgen dafür, dass der Server reibungslos läuft.

- Arbeitsspeicher (RAM): Um riesige Datensätze schnell verfügbar zu halten, brauchen AI-Server massig RAM. Wir empfehlen mindestens 64 GB, wobei 128 GB oder mehr für Profi-Anwendungen der Standard sind.

- Speicherplatz: KI braucht „Futter“ in Form von Daten. Daher ist ausreichend Kapazität auf HDDs oder – für den nötigen Speed – auf SSDs Pflicht.

- Netzwerkkarten: Eine schnelle Anbindung garantiert den flüssigen Datenaustausch innerhalb deiner Infrastruktur.

Software-Anforderungen für KI-Projekte

Hardware allein reicht nicht – erst die richtige Software macht den Server intelligent. Für das Training deiner Modelle benötigst du ein abgestimmtes Ökosystem.

- Betriebssystem: Als Basis dient meist eine Linux-Distribution wie Ubuntu, CentOS oder Debian, da diese Systeme KI-Frameworks hervorragend unterstützen.

- KI-Frameworks: Ohne Tools wie TensorFlow, PyTorch oder Keras läuft in der Welt des Machine Learnings wenig. Sie bieten die nötige Umgebung für deine Entwicklung.

- Softwarebibliotheken: Für die eigentliche Programmierung sind Bibliotheken wie NumPy oder Pandas die wichtigsten Werkzeuge in deinem Kit.

- KI-Modelle: Das Modell ist das eigentliche „Gehirn“, das die Aufgaben löst. Es wird kontinuierlich trainiert, um immer präzisere Ergebnisse zu liefern.

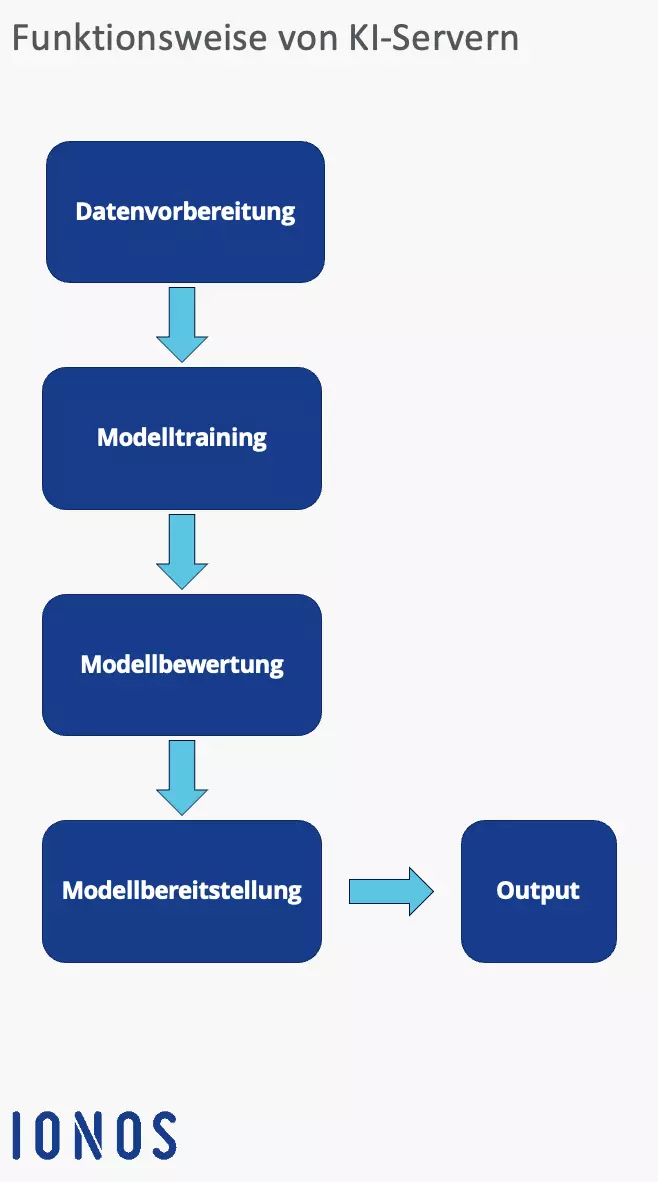

So arbeitet ein KI-Server

Ein AI-Server fungiert als Rechenzentrum, das Daten analysiert und daraus lernt. Mit Machine Learning oder Deep Learning entstehen Modelle, die später Prognosen erstellen, autonom entscheiden oder Content generieren. Der Prozess folgt meist diesem Schema:

- Datenaufbereitung: Zuerst werden die Rohdaten gesammelt, gesäubert und strukturiert, damit die KI damit arbeiten kann.

- Modelltraining: Hier passiert die Magie. Der Algorithmus nutzt die Übungsdaten und passt seine Parameter immer wieder an. Das ist extrem rechenintensiv und kann von Stunden bis zu Tagen dauern.

- Validierung: Das fertige Modell wird mit Testdaten auf die Probe gestellt. So prüfst du, wie exakt und zuverlässig die KI arbeitet.

- Deployment: Läuft alles glatt, geht das Modell live und verarbeitet echte Daten für den produktiven Einsatz.

Warum auf KI-Server setzen?

Ein eigener AI-Server ist dann der logische nächste Schritt, wenn Standardlösungen wie KI-Tools, AIaaS oder Cloud-KI an ihre Grenzen stoßen. Du profitierst von maximaler Kontrolle und Performance.

Ein riesiger Pluspunkt ist die Skalierbarkeit. Du kannst die Leistung exakt an dein Projekt anpassen und Ressourcen effizient nutzen. Im Vergleich zu Standard-Hardware sind KI-Server durch ihre spezialisierten GPUs perfekt auf die besonderen Workloads der künstlichen Intelligenz getrimmt.

Wo KI-Server den Unterschied machen

Überall dort, wo massive Datenmengen analysiert oder komplexe Muster erkannt werden müssen, sind AI-Server in ihrem Element. Ein prominentes Feld ist die Entwicklung autonomer Fahrzeuge, die Sensordaten in Echtzeit auswerten müssen. Aber auch bei der Text- und Bildgenerierung sind sie unverzichtbar: Moderne Large Language Models oder generative KI basieren auf den enormen Rechenkapazitäten dieser Server.