Fog-Computing

Das Internet of Things (IoT) transformiert die weltweite IT und gilt als Basis zahlreicher Zukunftskonzepte. Klassische IoT-Modelle, bei denen Daten zentral zusammenlaufen, stoßen jedoch aufgrund von Bandbreitenlimits an ihre Grenzen. Fog-Computing bietet hier innovative Ansätze, um diese Herausforderungen bei der IoT-Nutzung zu meistern.

Was ist Fog-Computing? Eine Definition

Unter Fog-Computing versteht man eine Cloud-Technologie, bei der Endgeräte-Daten nicht sofort in die Cloud wandern. Stattdessen findet eine Vorverarbeitung in dezentralen Minirechenzentren (sogenannten „Fog Nodes“) statt. Diese Netzwerkstruktur reicht von den äußeren Rändern, wo IoT-Geräte Daten erzeugen, bis zum zentralen Ziel in der Public Cloud oder einem privaten Rechenzentrum.

Das Ziel beim „Fogging“ ist es, Übertragungswege zu minimieren und die Datenlast in externen Netzen zu senken. Fog Nodes fungieren als Zwischenebene: Sie entscheiden, welche Informationen lokal verarbeitet werden und welche für tiefere Analysen an die zentrale Cloud oder das Rechenzentrum gehen.

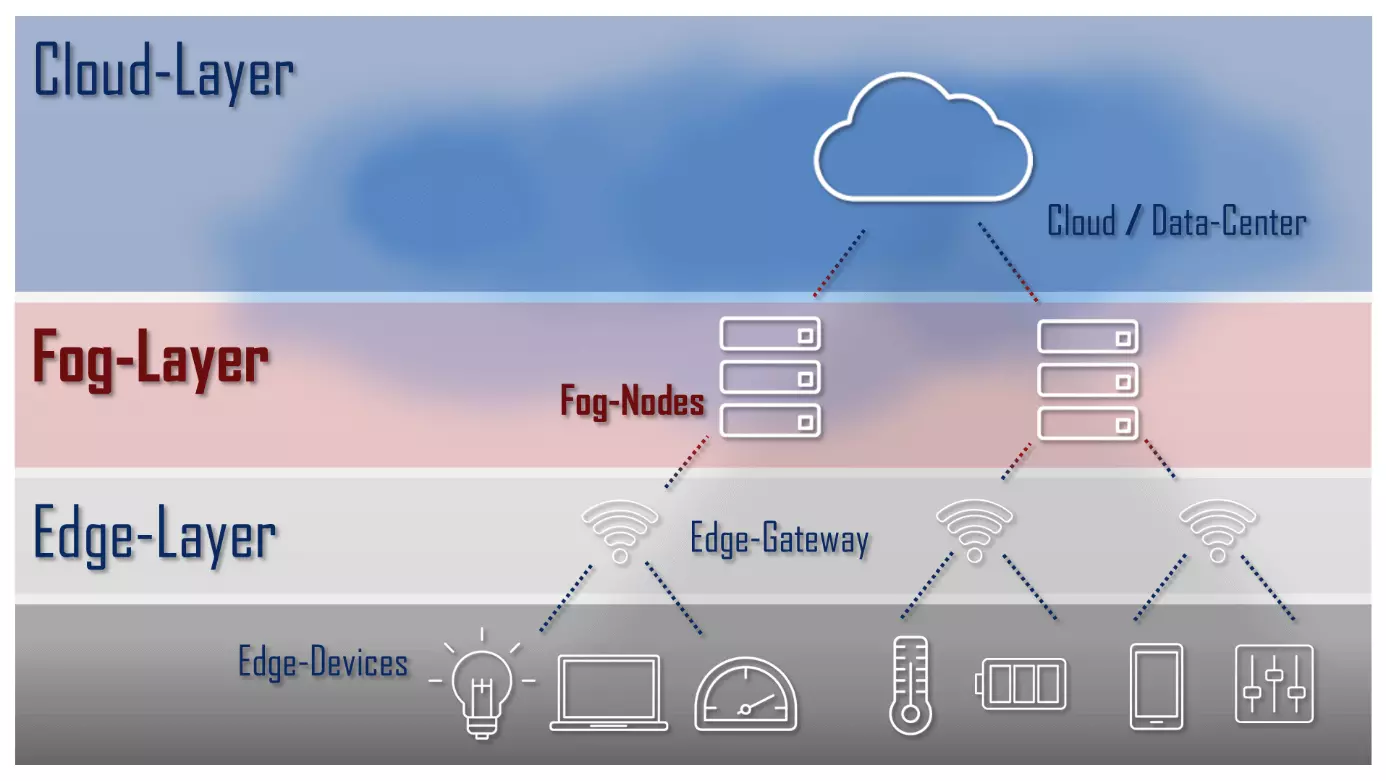

Die folgende Grafik verdeutlicht die drei Ebenen (Layer) einer typischen Fog-Computing-Struktur:

- Edge-Layer: Hier befinden sich alle smarten Geräte (Edge-Devices). Die dort erzeugten Daten werden direkt am Gerät verarbeitet oder an einen Fog-Node weitergereicht.

- Fog-Layer: Dieser besteht aus leistungsstarken Servern, welche die Daten vom Edge-Layer annehmen, aufbereiten und bei Bedarf hochladen.

- Cloud-Layer: Dies ist der zentrale Knotenpunkt und Endstation in der Fog-Computing-Architektur.

Eine Referenzarchitektur für Fog-Systeme wurde vom OpenFog Consortium (heute Industry IoT Consortium, IIC) erstellt. Weiterführende White Paper gibt es direkt auf der Website des IIC.

Unterschied zum Cloud-Computing

Der Hauptunterschied liegt im Ort der Datenverarbeitung. Cloud-Computing findet meist in großen, zentralen Rechenzentren statt. Ressourcen wie Rechenkraft und Speicher werden auf Backend-Servern gebündelt und von Clients via Netzwerk abgerufen. Die Kommunikation läuft dabei immer über einen zentralen Server.

In Szenarien wie der „Smart Factory“, wo massenhaft Geräte Daten austauschen, stößt dieses Modell an Grenzen. Fog-Computing setzt auf Verarbeitung direkt an der Quelle, um die Last auf das zentrale Rechenzentrum deutlich zu reduzieren.

Unterschied zum Edge-Computing

Neben der Datenmenge ist die Latenz ein Knackpunkt. Zentrale Verarbeitung verursacht durch die weiten Wege unvermeidbare Zeitverzögerungen. Sensoren müssen erst den Server im Rechenzentrum kontaktieren, was Echtzeit-Reaktionen erschwert – etwa in der automatisierten Fertigung.

Edge-Computing löst dies, indem die Verarbeitung direkt im Endgerät am Netzwerkrand („Edge“) erfolgt. Jedes smarte Gerät besitzt einen Micro-Controller für die Basis-Verarbeitung und den Austausch mit anderen Sensoren. Das sorgt für minimale Latenz und entlastet das Zentrum.

Fog- und Edge-Computing sind verwandt, aber nicht identisch. Der Kernunterschied ist der Zeitpunkt und Ort: Edge verarbeitet Daten direkt an der Quelle. Fog-Computing hingegen bündelt Rohdaten aus verschiedenen Quellen in einem Zwischenschritt. So können irrelevante Infos aussortiert werden, bevor sie das Haupt-Rechenzentrum erreichen. Welche Lösung ideal ist, entscheidet der jeweilige Anwendungsfall.

Vorteile von Fog-Computing

Fog-Computing liefert Antworten auf die Schwächen reiner Cloud-Infrastrukturen. Kurze Wege und minimale Uploads stehen im Fokus. Die wichtigsten Pluspunkte sind:

- Weniger Traffic: Die Netzlast zwischen IoT und Cloud sinkt deutlich.

- Niedrigere Kosten: Da weniger Daten über externe Netze geladen werden müssen, spart man bei den Provider-Gebühren.

- Offline-Betrieb: IoT-Systeme funktionieren in dieser Architektur auch ohne dauerhafte Internetverbindung.

- Minimale Latenz: Kürzere Wege beschleunigen Analysen und automatisierte Entscheidungen.

- Sichere Daten: Die Verarbeitung im lokalen Netz sorgt dafür, dass sensible Infos im Haus bleiben oder vorab verschlüsselt werden.

Nachteile von Fog-Computing

Die Verteilung auf viele kleine Einheiten bringt auch Herausforderungen mit sich, besonders bei der Verwaltung. Zu den Nachteilen zählen:

- Höhere Investitionen: Endgeräte benötigen mehr Power für die lokale Verarbeitung, was die Hardware-Kosten steigert.

- Mehr Aufwand: Die Wartung eines verteilten Systems ist komplexer als bei einer zentralen Cloud-Lösung.

- Security-Risiken: Durch die dezentrale Struktur entstehen neue Angriffsflächen, etwa für Man-in-the-Middle-Attacken.