Edge Computing

Im omnipräsenten Internet of Things (IoT) produzieren Geräte laufend Daten, die gespeichert und bei zeitkritischen Prozessen sofort analysiert werden müssen. Edge-Computing verarbeitet diese Infos direkt an der Entstehungsstelle und sorgt so für einen echten Wendepunkt im Zeitalter des Cloud-Computings.

Was ist Edge-Computing? Eine Definition

Edge-Computing ist ein Architekturkonzept für IoT-Umgebungen. Dabei werden IT-Ressourcen wie Rechenpower und Speicherplatz so nah wie möglich an den Endgeräten und Sensoren platziert. Damit bietet das Modell eine leistungsstarke Alternative zu klassischen Cloud-Lösungen mit zentralen Serverstandorten.

Der Name „Edge“ steht im Englischen für Kante oder Rand. Das verdeutlicht, dass die Datenverarbeitung nicht fernab in einem Rechenzentrum stattfindet, sondern dezentral am Rand des Netzwerks. So liefert Edge-Computing genau das, was die Cloud oft nicht schafft: Server, die riesige Datenmengen aus smarten Fabriken oder Verkehrsleitsystemen ohne Verzögerung auswerten und sofort reagieren können.

Wichtige Begriffe rund um Edge-Computing

Beim Edge-Computing werden bewährte Technologien kompakt und effizient neu kombiniert. Wir haben die wichtigsten Fachbegriffe für dich zusammengefasst.

- Edge: Damit ist in der IT der Netzwerkrand gemeint. Was genau dazu zählt, hängt vom Einsatzgebiet ab. Bei Mobilfunknetzen kann das Smartphone die Edge sein, bei vernetzten Fahrzeugen das Auto selbst.

- Edge-Device: Das ist jedes Gerät am Netzwerkrand, das Daten erzeugt. Dazu gehören Sensoren, Maschinen oder smarte IoT-Geräte wie vernetzte Thermostate, Feuermelder oder Leuchtmittel.

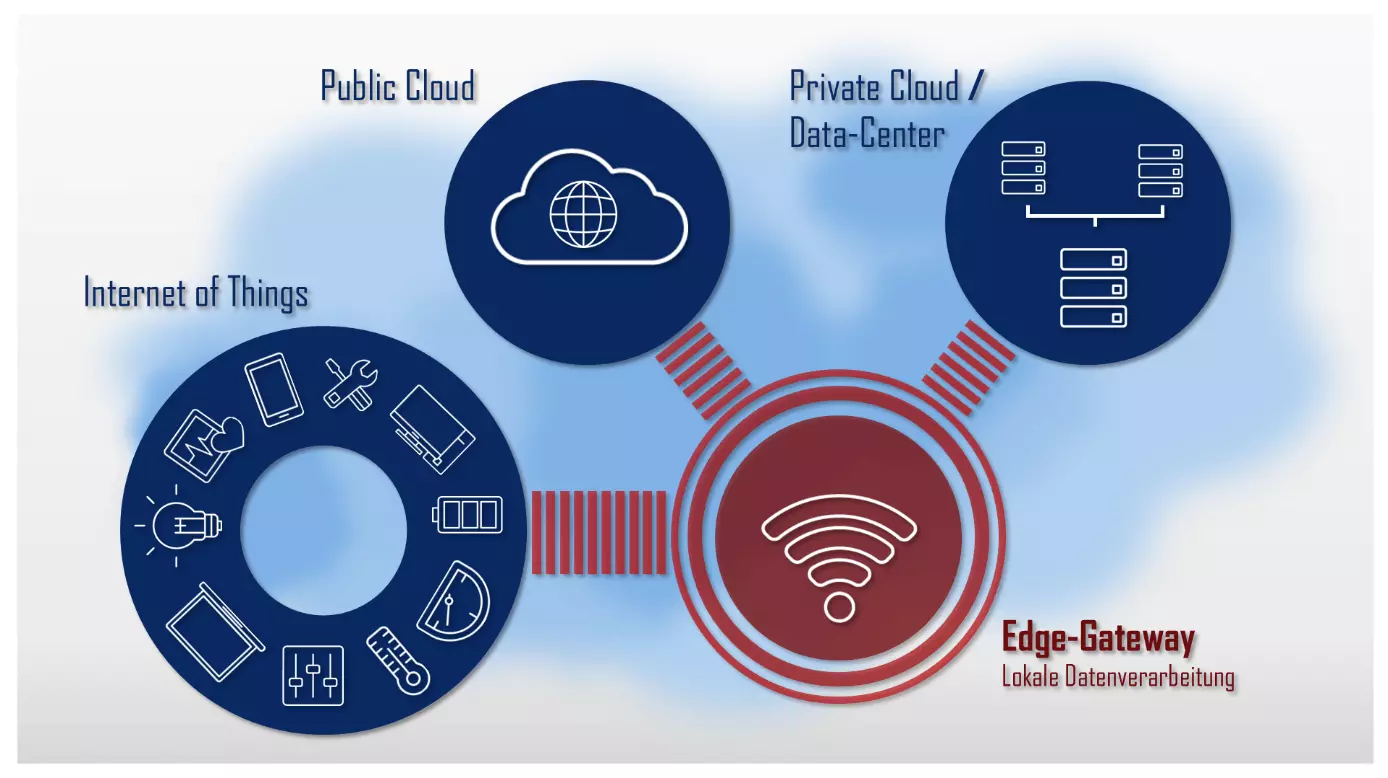

- Edge-Gateway: Dies ist die Schnittstelle zwischen zwei Netzwerken. In IoT-Szenarien fungieren diese Gateways als Knotenpunkte zwischen den IoT-Geräten und dem Kernnetzwerk.

Edge-Computing vs. Fog-Computing

Die Idee, die Cloud lokal zu erweitern, ist bewährt. Bereits 2014 prägte Cisco den Begriff Fog-Computing. Hier landen Daten nicht sofort in der Cloud, sondern werden in kleinen Zwischenstationen gesammelt, vorsortiert und analysiert.

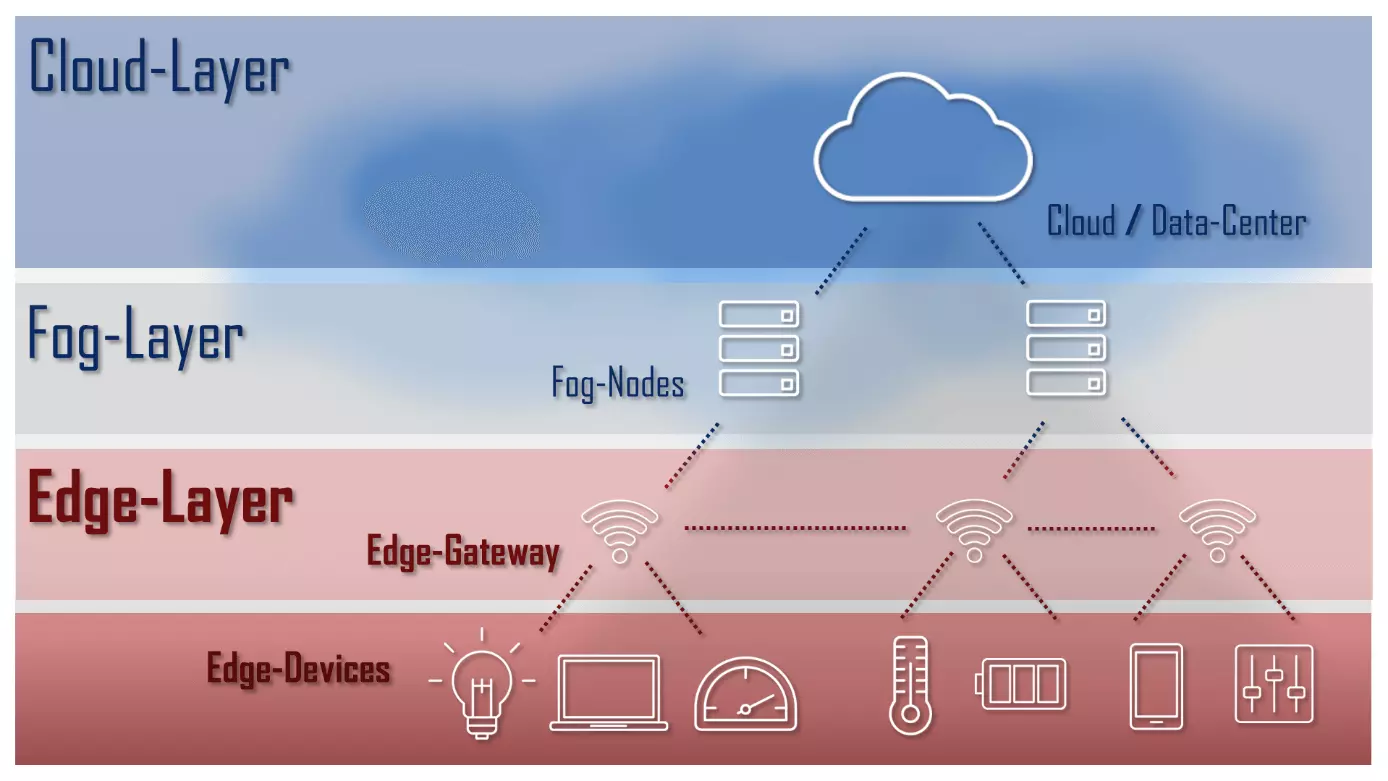

Heutzutage gilt Edge-Computing als spezifischer Teil des Fog-Computings. Der Fokus liegt dabei auf Ressourcen, die noch ein Stück näher an den IoT-Geräten sitzen. Oft werden beide Ansätze kombiniert, wie diese Grafik mit Cloud-, Fog- und Edge-Layer zeigt:

Standards für solche Architekturen werden vom Open Fog Consortium entwickelt, einem Verbund aus Forschung und Industrie.

Warum lohnt sich Edge-Computing?

Aktuell stemmen zentrale Rechenzentren fast die gesamte Internet-Last. Da Datenquellen aber oft mobil oder weit entfernt sind, kommt es zu Verzögerungen (Latenzen). Das ist kritisch für Anwendungen wie Machine Learning oder Predictive Maintenance – Kernbereiche der Industrie 4.0.

Predictive Maintenance (vorausschauende Wartung) verändert die Instandhaltung grundlegend. Durch smarte Überwachung werden potenzielle Defekte erkannt und behoben, noch bevor es zu einem Stillstand kommt.

Edge-Computing ist kein Ersatz für die Cloud, sondern die ideale Ergänzung mit diesen Vorteilen:

- Datenbündelung und Vorab-Check: Daten werden direkt an der Quelle erfasst und gefiltert. Nur was für Langzeit-Analysen oder die Archivierung relevant ist, wandert am Ende in die Cloud.

- Dezentraler Speicher: Riesige Datenmengen lassen sich oft nicht schnell genug übertragen. Edge-Gateways lösen das, indem sie Daten lokal vorhalten – ähnlich wie ein Replica-Server in einem Content-Delivery-Network.

- Smartes Monitoring: In Verbindung mit KI ermöglicht Edge-Computing eine Überwachung aller Geräte in Echtzeit.

- M2M-Vernetzung: Es fördert die M2M-Kommunikation, also den direkten Datenaustausch zwischen vernetzten Maschinen.

Die Grafik zeigt das Prinzip einer dezentralen Architektur, bei der Edge-Gateways als Brücke zwischen der zentralen Cloud und den IoT-Geräten fungieren:

Wo wird Edge-Computing eingesetzt?

Die meisten Einsatzgebiete liegen im IoT-Sektor. Besonders dort, wo Reaktionen in Echtzeit über Erfolg oder Sicherheit entscheiden, ist dezentrale Verarbeitung essenziell:

- Car-to-Car-Kommunikation: Unverzichtbar für Warnsysteme und autonomes Fahren.

- Smart Grid: Intelligente Stromnetze, die Schwankungen sofort ausgleichen und den Verbrauch in Echtzeit steuern.

- Smart Factory: Vernetzte Fabriken und Logistikketten, die sich durch lokale Rechenpower selbst organisieren.

Vorteile von Edge-Computing

Im Vergleich zur klassischen Cloud bietet Edge-Computing klare Pluspunkte:

- Echtzeit-Verarbeitung: Keine spürbaren Verzögerungen, da die Analyse direkt vor Ort passiert.

- Effiziente Bandbreite: Da Daten lokal gefiltert werden, wird das Netzwerk deutlich weniger belastet.

- Sorgenfreie Compliance: Datenschutzvorgaben lassen sich durch lokale Speicherung oft einfacher umsetzen.

Nachteile von Edge-Computing

Trotz der Stärken gibt es Punkte, die bei der Planung bedacht werden müssen:

- Höhere Komplexität: Verteilte Systeme sind in der Struktur anspruchsvoller als eine zentrale Lösung.

- Investitionskosten: Die nötige Hardware vor Ort sorgt anfangs für ein höheres Budget.

- Wartungsaufwand: Viele dezentrale Komponenten bedeuten mehr Aufwand bei Service und Administration.