Docker-Tools

Das umfangreiche Docker-Ökosystem eröffnet dir als Entwickler:in zahlreiche Wege, Anwendungen zu deployen oder Container zu orchestrieren. Wir stellen dir die relevantesten Docker-Tools vor und zeigen dir beliebte Open-Source-Projekte von Drittanbietern, die das Ökosystem erweitern.

Die wichtigsten Docker-Komponenten im Überblick

Docker hat sich längst von einer reinen Plattform für Software-Container zu einem mächtigen Werkzeugkasten entwickelt. Damit du deine Anwendungen über verschiedene Infrastrukturen und Cloud-Lösungen hinweg flexibel ausrollen kannst, bietet dir world4you mit der Kern-Software verschiedene Docker-Tools an. Neben Funktionen für Cluster und Orchestrierung erhältst du Zugriff auf einen App-Marktplatz sowie Tools zur Verwaltung deiner Ressourcen.

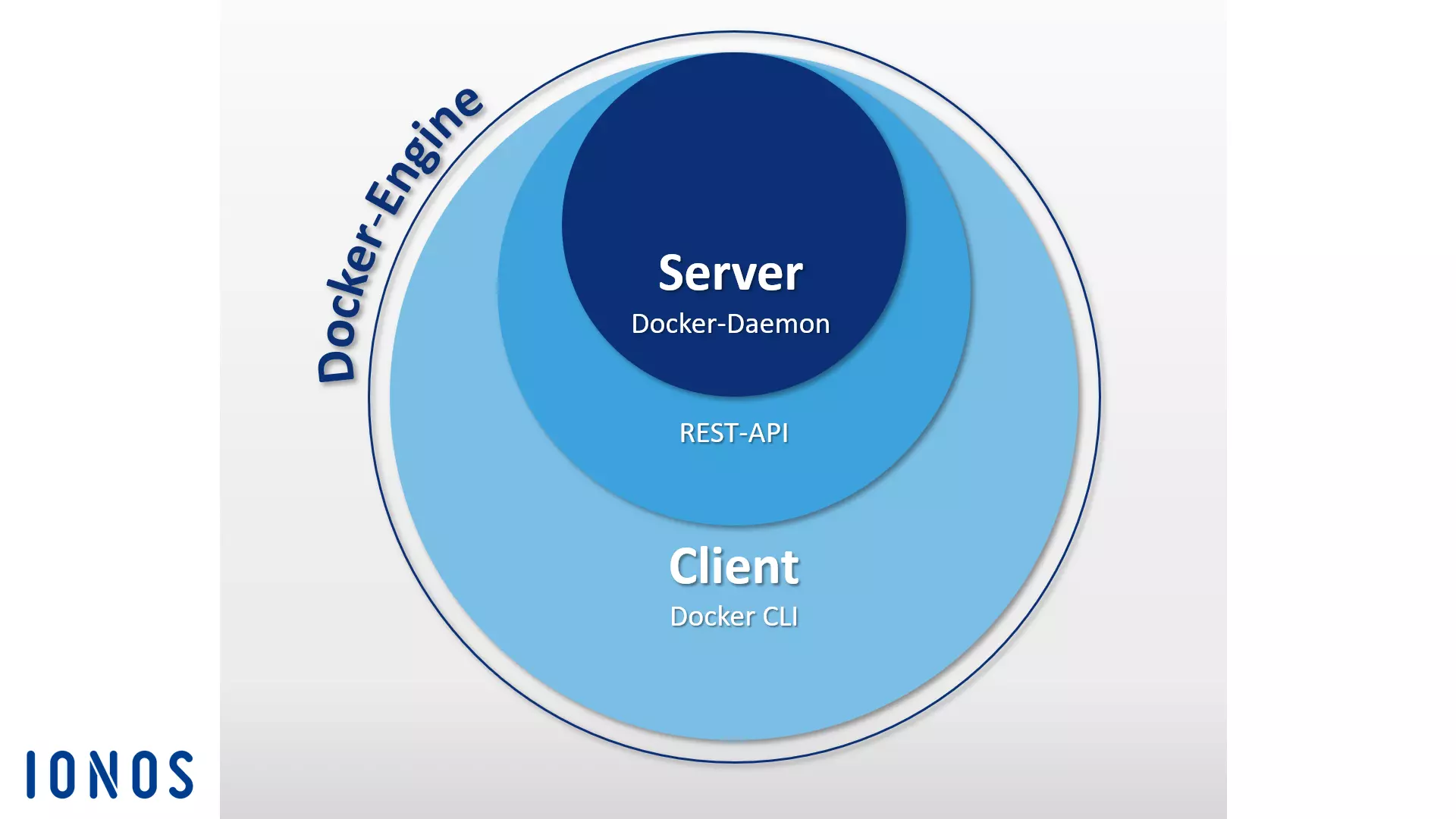

Docker-Engine

Wenn die Rede von „Docker“ ist, meint man meist die quelloffene Client-Server-Anwendung hinter der Plattform. In der Fachsprache nennen wir das „Docker-Engine“. Sie besteht im Kern aus dem Docker-Daemon, einer REST-API und dem CLI (Command Line Interface). Dank dieses Aufbaus steuerst du die Engine direkt über das Terminal und verwaltest Images, Dockerfiles und Container mit einfachen Befehlen. Dabei können Client und Daemon sogar auf unterschiedlichen Systemen laufen. Eine Liste der gängigen Docker-Befehle findest du in unserem Detail-Artikel.

Docker-Hub

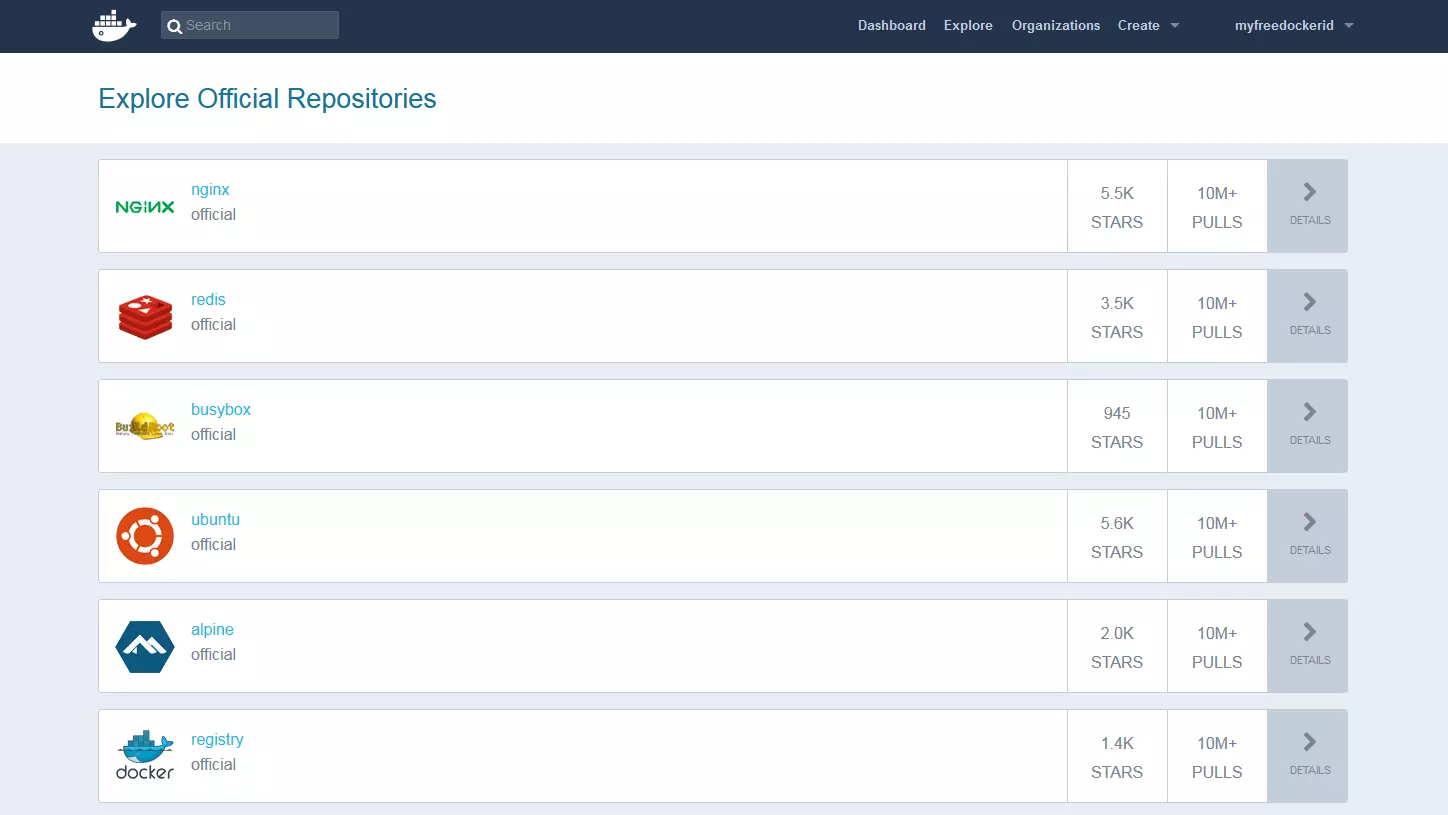

Der Docker-Hub dient dir als cloudbasierte Registry. Hier kannst du Images laden, zentral verwalten und mit der Community teilen. Als angemeldete Person entscheidest du, ob du deine Images öffentlich oder in privaten Bereichen (Repositorys) sicherst. Ein Tag-System hilft dir dabei, verschiedene Versionen sauber zu trennen.

Im Hub warten zudem tausende Ressourcen in offiziellen Archiven auf dich – bereitgestellt vom Docker-Team selbst oder bekannten Open-Source-Größen. Besonders gefragt sind der Webserver NGINX, die In-Memory-Datenbank Redis, BusyBox oder die Linux-Basis Ubuntu.

Praktisch sind auch die „Organizations“: Diese Arbeitsgruppen erlauben es dir, private Repositorys gezielt für dein Team freizugeben. Die Rechte steuerst du dabei ganz einfach über die Teamzugehörigkeit.

Docker Swarm

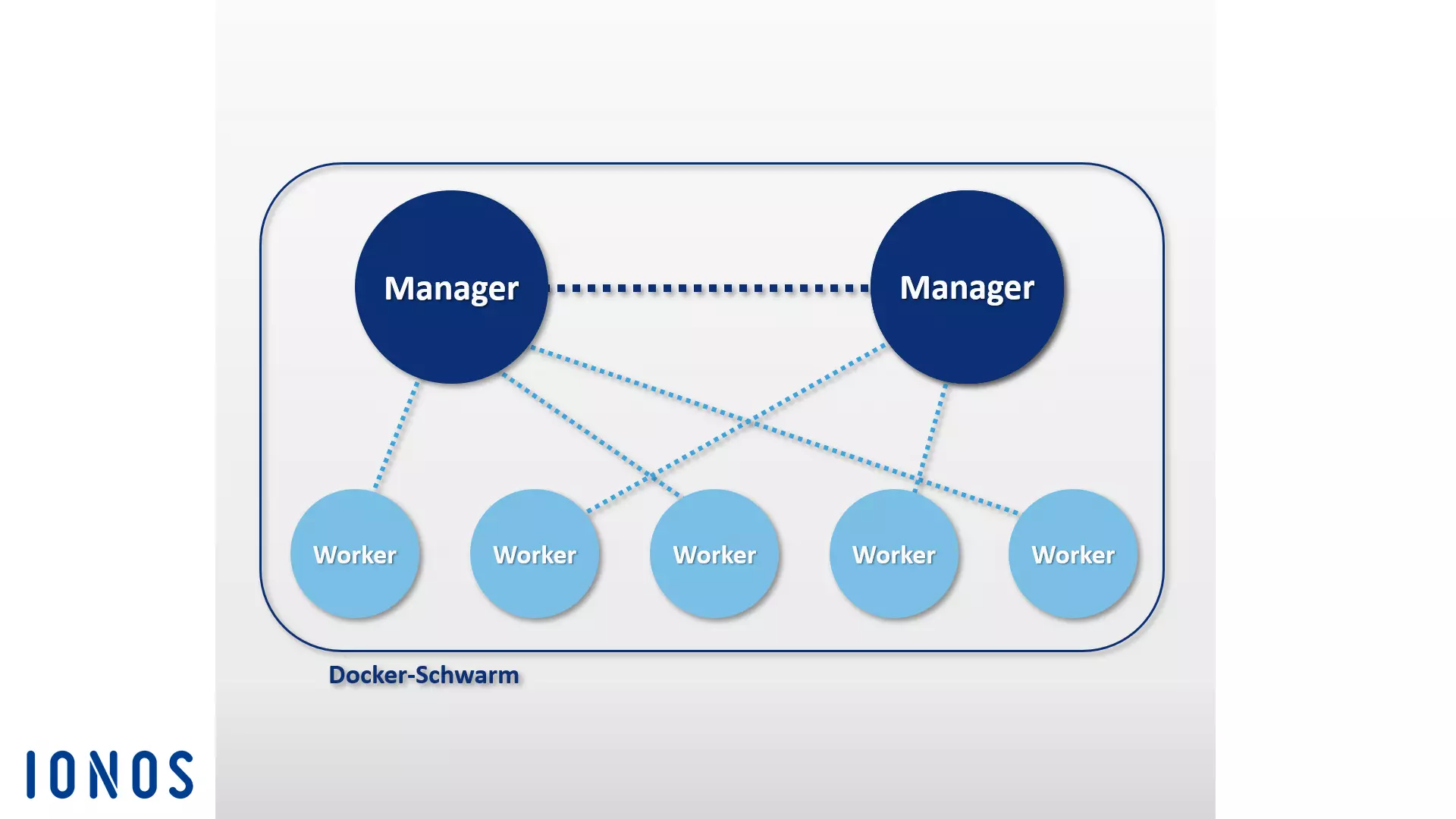

Direkt in der Engine findest du Funktionen, um Docker-Hosts in Clustern (Swarms bzw. Schwärmen) zu bündeln. Diese integrierten Features basieren auf dem Toolkit Swarmkit.

Mit Swarm fasst du diesen Pool zu einem einzigen virtuellen Host zusammen. Jedes Tool, das mit dem Docker-Daemon spricht, kann so auf den Schwarm zugreifen und die Anwendungen skalieren. Du nutzt einfach das bekannte CLI, um Cluster zu bauen und Anwendungen zu verteilen. Eine extra Orchestrierungs-Software brauchst du nicht.

Sobald du einen Host zu einem Schwarm machst, läuft er im Swarm-Mode. Die einzelnen Teilnehmer heißen „Knoten“ (Nodes). Diese können lokal existieren, meist verteilt man sie aber über verschiedene Cloud-Systeme für maximale Ausfallsicherheit.

Das System nutzt eine Master-Slave-Struktur. Willst du etwas erledigen, gibst du einen „Service“ an den Manager-Node (Master) weiter. Er plant das Scheduling der Container und ist deine Schnittstelle zum Schwarm.

Der Master teilt die Arbeit in „Tasks“ auf und schickt diese an die Worker-Nodes (Slaves).

- Services: Das Herzstück im Cluster. Ein Service ist eine Gruppe identischer Container. Er legt fest, welches Image genutzt wird und welche Befehle laufen. Hier steuerst du auch die Skalierung: Gib einfach an, wie viele Instanzen gleichzeitig aktiv sein sollen.

- Tasks: Der Manager zerlegt Services in diese kleinen Einheiten. Ein Task enthält jeweils einen Container samt seiner Anweisungen.

Standardmäßig übernimmt ein Manager-Node auch Worker-Aufgaben, außer du konfigurierst ihn rein für die Verwaltung.

Auf den Workern sorgt ein Agent-Programm für den reibungslosen Ablauf und meldet den Status zurück an den Master. Hier siehst du das Prinzip im Überblick:

Für die Einrichtung nutzen viele Profis zusätzlich die Docker-Machine.

Docker Compose

Mit Docker Compose verknüpfst du mehrere Container zu einer Einheit und startest sie zeitgleich. Alles wird in einer zentralen Datei auf YAML-Basis definiert. Wenn du Vagrant kennst, wird dir die Syntax sehr vertraut vorkommen.

In der docker-compose.yml hältst du fest, welche Container wie zusammenarbeiten. Den gesamten Zyklus steuerst du bequem über den Befehl docker-compose – egal ob lokal oder auf verteilten Systemen.

Besonders stark: Compose lässt sich direkt in Swarm-Cluster einbinden. Zudem bietet es einen Mechanismus zur Skalierung, mit dem du per Kommandozeile festlegst, wie oft ein Service gestartet wird.

Externe Tools für dein Docker-Setup

Neben den Bordmitteln von Docker Inc. gibt es eine riesige Auswahl an externen Software-Lösungen. Diese nutzen meist die Docker-Schnittstellen oder sind exakt darauf zugeschnitten. Zu den Stars der Open-Source-Szene gehören Kubernetes, Shipyard für das Management, Panamax für das Shipping, die CI-Plattform Drone sowie Cloud-Systeme wie OpenStack oder D2iQ DC/OS.

Kubernetes

Früher hatte Docker keine eigenen Orchestrierungs-Tools wie Swarm an Bord. Deshalb entwickelten Firmen eigene Lösungen, um Container in großen Umgebungen zu bändigen. Das Ergebnis ist Kubernetes (oft K8s abgekürzt).

Kubernetes ist ein Manager für Container-Cluster mit dem Ziel, Abläufe zu automatisieren. Gesteuert wird alles via API, Terminal oder Web-Interface. Mit Kubernetes kannst du:

- Anwendungen auf Clustern betreiben,

- Container-Setups zentral verwalten,

- Ressourcen dynamisch skalieren und

- deine Hardware ideal auslasten.

Die kleinste Einheit sind dabei „Pods“ – logische Gruppen von Containern, die gemeinsam auf die Reise durch das Cluster geschickt werden.

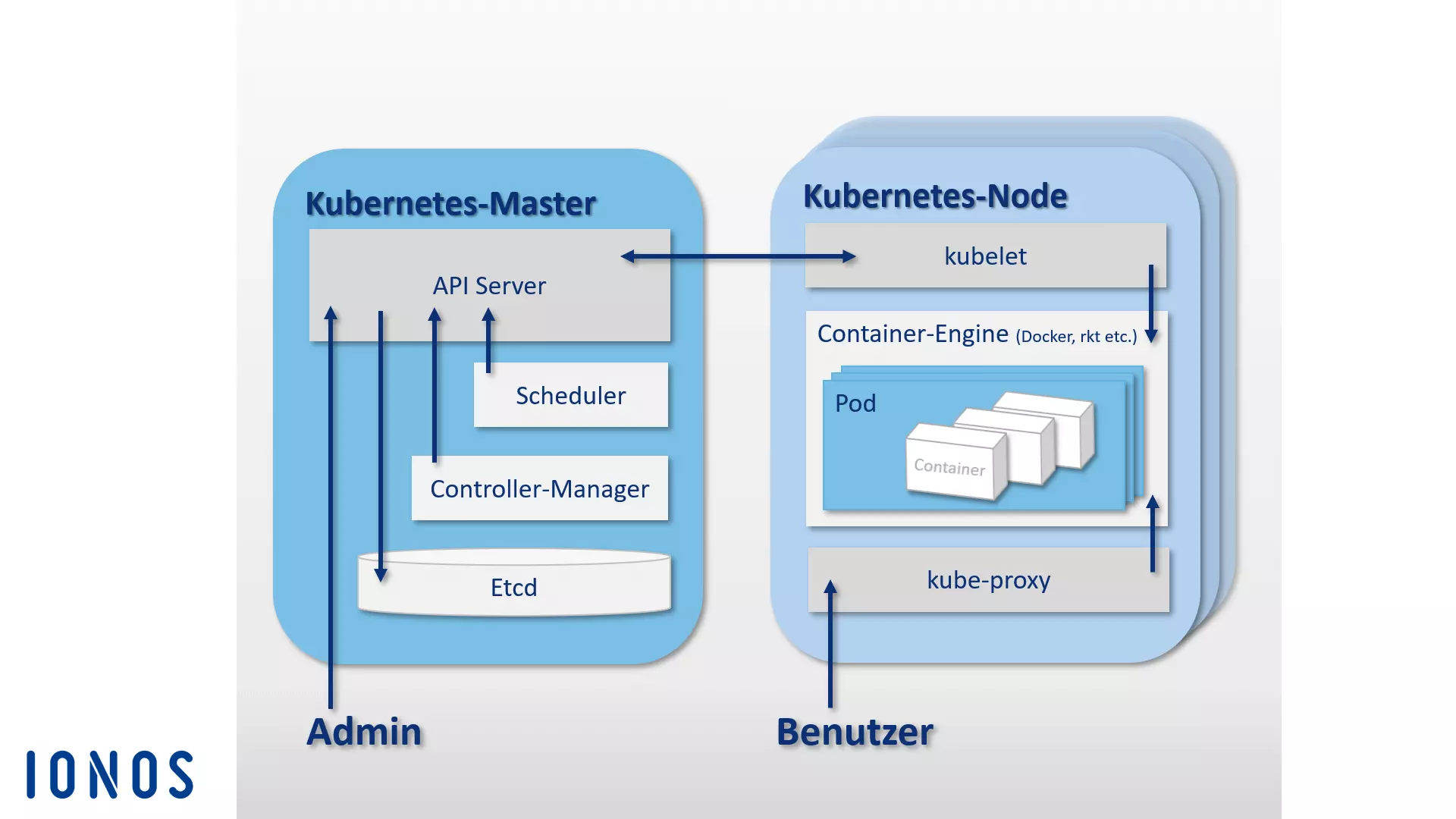

Auch hier begegnet uns die Master-Slave-Architektur. Ein Master (Control Plane) steuert die Worker-Nodes (Minions). Der Master nutzt dafür vier Säulen: den API-Server, den Speicher etcd, den Scheduler und den Controller-Manager.

- API-Server: Das Tor zum Cluster. Alle Befehle laufen hier über die REST-Schnittstelle zusammen.

- etcd: Das Gedächtnis des Clusters. Dieser Key-Value-Store sichert alle Konfigurationen und teilt sie den Knoten mit.

- Scheduler: Der Planer. Er entscheidet anhand der verfügbaren Hardware, welcher Pod auf welchem Knoten landet.

- Controller-Manager: Der Wächter. Er prüft ständig, ob der Ist-Zustand deines Clusters noch mit deinen Vorgaben übereinstimmt, und greift bei Bedarf ein.

Diese Komponenten können auf einem Server liegen oder für maximale Sicherheit auf mehrere Master-Hosts verteilt werden.

Die eigentliche Arbeit leisten die Nodes. Dort muss eine Container-Engine laufen – meist ist das Docker, wobei Kubernetes auch mit anderen Systemen klarkommt. Zusätzlich braucht jeder Node:

- kubelet: Der Agent vor Ort. Er hält den Kontakt zum Master und sorgt dafür, dass die Pods wie gewünscht laufen.

- kube-proxy: Er regelt den Netzwerkverkehr. Er leitet Anfragen von außen an die richtigen Container weiter und bietet einfaches Load-Balancing.

Hier siehst du, wie Kubernetes aufgebaut ist:

Ergänzend gibt es viele Hilfsmittel: Monitoring-Tools wie Prometheus oder sysdig sowie den Paket-Manager Helm. Auch für Java-Entwickler:innen gibt es passende Schnittstellen via Maven oder Gradle.

Shipyard

Shipyard ist ein Community-Projekt für Swarm. Es bietet dir eine grafische Oberfläche im Browser, um Container, Images und Hosts intuitiv zu verwalten. Die Software ist voll kompatibel zur Docker-API und nutzt RethinkDB für die Datenhaltung.

Neben dem Management via Web-UI bietet Shipyard eine Benutzerverwaltung mit Rollen und Rechten. Es besteht aus drei Teilen:

- Controller: Das Gehirn. Er spricht mit der Datenbank und steuert die Hosts im Cluster.

- API: Die Basis. Alle Funktionen laufen über diese REST-Schnittstelle.

- User-Interface: Die Oberfläche. Eine moderne App, mit der du alles bequem im Blick behältst.

Weitere Details findest du auf der Projekt-Website.

Panamax

Das Tool Panamax will das Deployment von Multi-Container-Apps so einfach wie möglich machen. Per Drag-and-Drop baust und verteilst du komplexe Setups direkt über eine Weboberfläche.

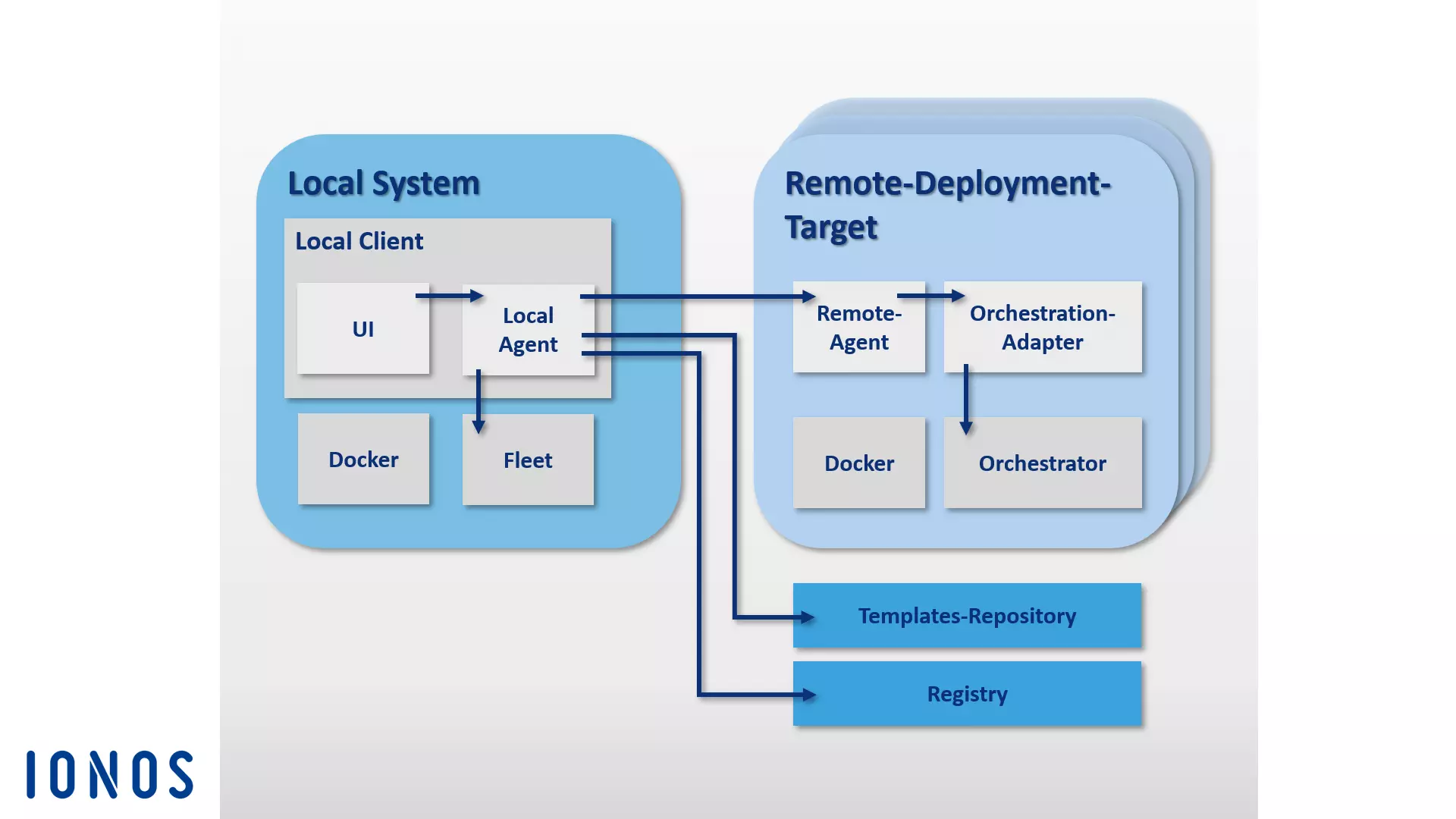

Deine Konfigurationen speicherst du als Templates und rollst sie mit einem Klick aus. Über einen Marktplatz auf GitHub kannst du Vorlagen auch mit anderen teilen. Das System unterscheidet zwischen dem Local-Client (deinem Rechner) und den Remote-Deployment-Targets (den Servern im Cluster).

Der Local-Client ist das Steuerzentrum und läuft idealerweise auf CoreOS. Er nutzt folgende Module:

- CoreOS & Fleet: Als spezialisierte Linux-Basis nutzt CoreOS den Manager „Fleet“ für die Orchestrierung der Container.

- Local Agent: Er verbindet alles. Er kommuniziert mit deiner UI, der Docker-API und den Servern im Cluster.

Die Deployment-Targets sind die Knoten, auf denen deine Apps am Ende laufen. Sie benötigen lediglich den Remote-Agent und einen passenden Adapter (z. B. für Kubernetes oder Fleet), um Befehle von deinem Client zu empfangen.

Panamax ist ideal, wenn du komplexe Strukturen grafisch verwalten und dabei flexibel bei der Orchestrierung bleiben willst.

Drone

Drone ist eine schlanke Plattform für Continuous Integration. Damit ziehst du dir automatisch den neuesten Code aus Repositorys wie GitHub und testest ihn sofort in isolierten Containern. Du erhältst Berichte direkt per E-Mail und jeder Testlauf startet in einer sauberen Umgebung.

Drone ist perfekt in Docker integriert und unterstützt Sprachen wie PHP, Node.js, Ruby, Go oder Python. Es ist eine tolle Open-Source-Alternative zu Tools wie Jenkins, die oft komplexer in der Handhabung sind.

OpenStack

Für eigene Cloud-Strukturen ist OpenStack der Goldstandard. Damit verwaltest du Speicher, CPU und Netzwerke deines Rechenzentrums über ein zentrales Dashboard.

Die modulare Architektur bietet dir alles, was du brauchst:

- Zun: Der Service für Container. Er erlaubt dir das Management von Apps, ohne dass du dich um die Server-Details kümmern musst.

- Neutron & kuryr: Neutron regelt das Netzwerk, während kuryr als Brücke zu Docker dient.

- Keystone: Dein Sicherheitssystem für Identitäten und Zugriffsrechte.

Mehr dazu liest du in unserem Artikel über OpenStack.

D2iQ DC/OS

DC/OS steht für „Distributed Cloud Operating System“ und basiert auf Apache Mesos. Es fungiert quasi als Betriebssystem für dein ganzes Rechenzentrum. Es bündelt alle Ressourcen zu einem großen, logischen System, das du so einfach wie einen einzelnen PC steuerst.

Die Software automatisiert das Ressourcenmanagement und das Scheduling. Die Verwaltung erfolgt über CLI oder Web-Interface. Zu den Kernstücken gehören:

- Mesos-Master & Agents: Der Master plant die Aufgaben, die Agents führen sie in Containern aus und melden freie Kapazitäten zurück.

- Marathon: Das „init-System“ für deine Apps. Es startet, überwacht und skaliert deine Dienste im Cluster.

Mit dem „Universe“ gibt es zudem einen App-Katalog, aus dem du Tools wie Spark, Cassandra oder Jenkins mit einem Klick installierst.

Sicherheit in der Docker-Welt

Docker nutzt clevere Isolationstechniken wie Namespaces, um Prozesse voneinander zu trennen. Dennoch teilen sich Container denselben Kernel, weshalb sie nicht ganz so streng isoliert sind wie klassische VMs. world4you empfiehlt daher zusätzliche Sicherheitsanker wie AppArmor oder SELinux.

- AppArmor: Regelt, auf welche Dateien ein Container zugreifen darf.

- SELinux: Ein Regelwerk für den Zugriff auf Kernel-Ressourcen.

- Seccomp: Überwacht und beschränkt Systemaufrufe.

Ein weiteres Thema ist die Herkunft von Images. Da jeder im Docker-Hub Inhalte hochladen kann, solltest du nur vertrauenswürdigen Quellen vertrauen. Achte auf zertifizierte Images: Docker bietet ein Programm an, bei dem Software auf Herz und Nieren geprüft wird. Das gibt dir die nötige Sicherheit für deine Produktivsysteme.